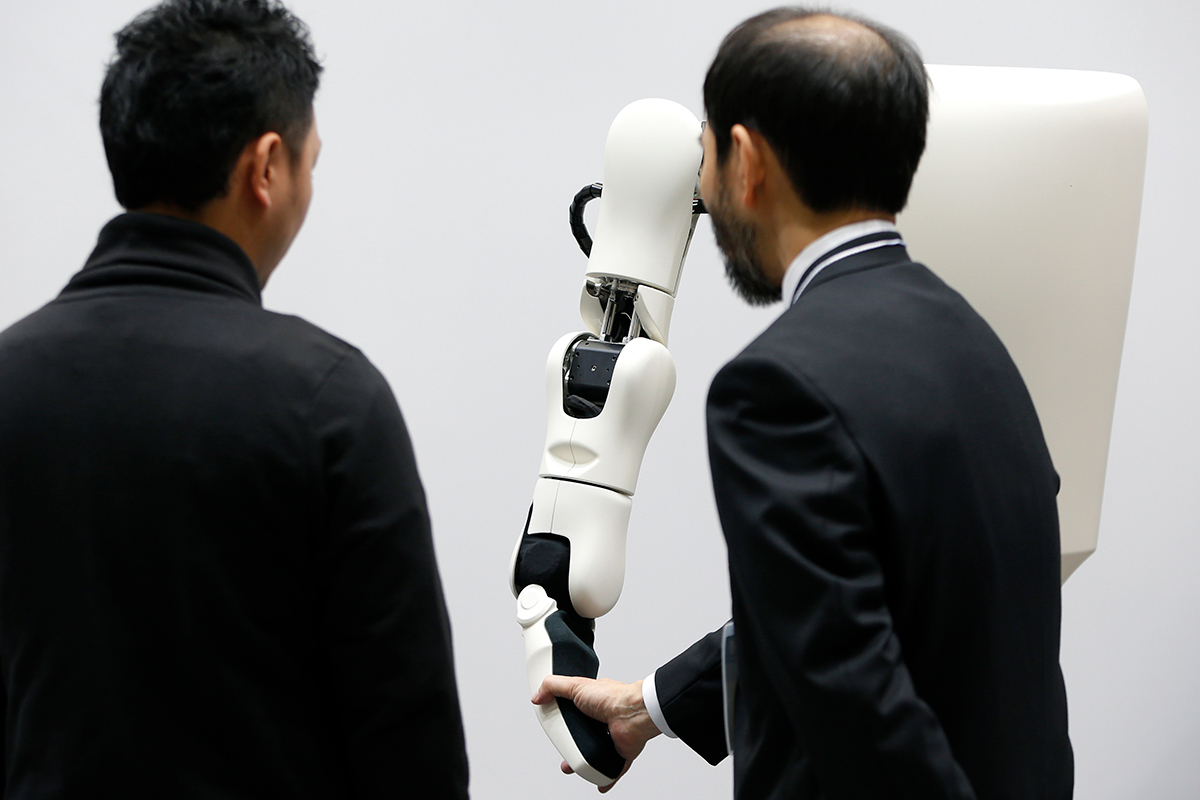

Правовые проблемы робототехники

1. Понятие робота

В мире существуют десятки трактовок и определений понятия «робот». Сами аналитики Сбербанка предлагают подход, основанный на трех критериях: восприятие окружающего мира, интерпретация полученной информации и дальнейшее воздействие на физический мир. Но это лишь одна из трактовок. Для правоведов понятие робота должно быть ни широким, ни узким, но точным:

- слишком широкое определение позволит включить в понятие «робота» обыденные приборы вроде кофемашин;

- слишком узкое определение не позволит охватить такие устройства, как робот-пылесос, которые тоже являются роботами;

- привязка же к слову «робот» грозит распространить регулирование на такие явления, как поисковый или торговый роботы;

- наконец, непонятно, что делать со смежными понятиями, например киборг, дрон или андроид.

Выходом, считают авторы доклада, может стать отказ от поисков единого словесного определения робота в пользу набора критериев, совпадение которых позволяет категоризировать некое устройство как робота. В отчете ЮНЕСКО о робоэтике за 2017 год приводится четыре таких критерия:

- мобильность;

- интерактивность (это как раз возможность собирать информацию из мира и воздействовать на него);

- обмен информацией;

- автономия (способность принимать решения без помощи человека).

2. Ответственность за причиняемый вред

Это одна из самых сложных и запутанных правовых проблем робототехники, которая допускает различные решения, исходя из ситуации и типа робота. Правда, в некоторых случаях восстановить фактические обстоятельства причинения вреда очень трудно. Авторы доклада выделяют семь основных подходов к проблеме ответственности:

- полное освобождение кого-либо от ответственности. Для этого надо признать действия автономных машин обстоятельствами непреодолимой силы;

- частичное освобождение от ответственности. Отличается тем, что пострадавшей стороне назначают компенсацию. Откуда — из страхового фонда или владельца робота — другой вопрос;

- ответственность по вине. Если происшествие вызвано дефектами конструкции, ее берет на себя производитель; если произошел компьютерный сбой, то разработчик. Если робот является самообучаемым — тот, кто внес наибольший вклад в его обучение. Если робот выполнял конкретные команды, то оператор устройства и так далее;

- ограниченная безвиновная ответственность, то есть признание ответственности за третьим лицом (владельцем или производителем), которое невиновно в происшествии, при соблюдении ряда условий, например страхования рисков;

- полная безвиновная ответственность. Некое лицо по умолчанию отвечает за действия робота;

- личная ответственность робота, которая подразумевает наделение машины правосубъектностью;

- смешанный режим ответственности, при котором те или иные подходы применяются в зависимости от степени опасности робота и других его характеристик.

3. Права на интеллектуальную собственность

Если робот создает музыку, картину или текст, кому принадлежат на них права? Производителю робота или тому, кто руководил процессом создания творческого объекта? Самому ли роботу? Или, возможно, эти права не должны принадлежать никому, автоматически становясь общественным достоянием? Выбор конкретного решения остается пока открытым.

4. Принципы регулирования

Базовая юридическая проблема робототехники — какими вообще должны быть руководящие начала, применяемые ко всем роботам или некоторым их категориям? Нужно ли законодательно фиксировать наличие у робота «черного ящика» и красной кнопки экстренного выключения, обеспечивать обязательный контроль со стороны человека? На бумаге эти принципы еще не утверждены, хотя в экспертном сообществе они активно обсуждаются, в том числе и в России, отмечают аналитики Сбербанка.

5. Права роботов

Вопрос того, обладает ли «умная» машина личностными характеристиками, был поднят еще создателем термина «робот» Карелом Чапеком. За почти 100 лет однозначного ответа на него найдено так и не было, сейчас существуют несколько взаимоисключающих предложений:

- робот как объект права (примерно так дела обстоят и сейчас, так что перекраивать все законодательство не потребуется);

- робот как животное, то есть включение «умных» машин в законодательство о домашних животных либо создание аналогичного набора норм в отношении роботов;

- робот как юридическое лицо, что также не потребует сильных перемен в законодательстве, закрыв попутно ряд правовых лакун;

- робот как человек, что является самым радикальным, трудным и наименее оправданным подходом, считают авторы обзора;

- робот как электронное лицо, то есть принципиально новый субъект права, слабо отличающийся по смыслу от юридического лица.

6. Информационная безопасность

Проблемы, которым сейчас уделяется минимальное внимание, но которые по мере распространения роботов станут ключевыми, — что будут делать машины с собранной ими информацией и как сделать так, чтобы она не попала в чужие руки? Это напрямую связано с защитой персональных данных, а также правилами обработки больших массивов информации. Пока решения у этой проблемы нет.

7. Роботы на войне

Уже сейчас один из самых распространенных видов роботов по числу активных устройств — это военная техника, скажем, беспилотные летательные аппараты. С точки зрения национальной безопасности это крайне перспективная и интересная для властей сфера, а значит, щедро финансируемая. С другой стороны, если подобная машина для убийств выйдет из-под контроля, это будет иметь самые плачевные последствия для людей и общества.

Поэтому сейчас, пишут авторы обзора, эксперты ООН и несколько десятков государств активно лоббируют включение военных роботов в Конвенцию о запрещении или ограничении специальных видов вооружения 1980 года наравне с лазерным оружием, противопехотными минами и прочими антигуманными устройствами.

Этическая сторона вопроса

Смежная с нормативно-правовым регулированием тема — этические последствия внедрения роботов в жизнь человека. Основополагающая концепция — законы робототехники, сформулированные Айзеком Азимовым еще в 1942 году.

1. Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.

2. Робот должен повиноваться всем приказам, которые дает человек, кроме тех случаев, когда эти приказы противоречат первому закону.

3. Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит первому или второму законам.

Законы Азимова настолько сильно определили подход к робоэтике, что на них ссылаются даже официальные документы, например резолюции Европарламента. Другие исследователи пытались дополнять и видоизменять три классических закона, тенденция последних лет — добавление к законам робототехники этических правил искусственного интеллекта (ИИ). Так, гендиректор Microsoft Сатья Наделла в 2016 году представил десять законов ИИ, куда вошли требования непредвзятости, технологической прозрачности, предотвращения вреда и так далее. За решения компьютера, по мнению Наделлы, ответственность несет все же человек.

Этической проблемой роботизации является также перспектива массовой безработицы из-за повсеместной автоматизации труда. Алгоритмизация процедур и расширение применения роботов в ближайшие 20 лет может затронуть треть рабочих мест во всем мире. В свою очередь создатели и операторы роботов, вооруженные знаниями, могут стать узкой, но могущественной прослойкой населения, что усугубит социальное неравенство.

В конечном итоге автоматизация ряда профессий потребует изменения системы образования, которая должна будет поддерживать необходимые в новых условиях навыки, помогая человеку раскрывать свои сильные стороны, которые невозможно будет заменить машиной. Аналитики Сбербанка также предлагают несколько возможных решений проблемы роботизации экономики:

- введение налога на роботов;

- гарантия человеку безусловного базового дохода;

- всеобщая гарантированная занятость;

- создание системы социального страхования;

- обновление образовательных программ.