Gemma 3 — это современная генеративная модель искусственного интеллекта (Large Language Model, LLM), которую создала компания Google. Она доступна для бесплатного использования и разработки и относится к целому семейству облегченных открытых моделей, созданных на основе тех же исследований, что и флагманская модель Google Gemini.

Содержание:

Первое поколение Gemma представили в феврале 2024 года, второе — в июне 2024-го. В марте 2025 года вышла Gemma 3, вобравшая в себя все наработки предыдущих версий и новые возможности.

Общий обзор и история создания

Gemma 3 — это наиболее продвинутая версия открытой модели семейства Gemma, разработанного подразделением Google DeepMind. Модель создавалась как часть стратегии Google по демократизации ИИ-технологий — она открыта, бесплатна и пригодна для запуска даже на относительно простом оборудовании (например MacBook на чипе M1). Название Gemma происходит от латинского слова gem — «драгоценный камень», — подчеркивая ценность технологии. Если флагманские модели Gemini остаются закрытыми и ресурсоемкими, то Gemma представляет их «облегченную» версию для широкого круга разработчиков и исследователей.

Первая версия Gemma (2024) была доступна в двух версиях, которые содержали 2 и 7 млрд параметров. Ту версию обучали в основном на англоязычных текстах, включая данные с веб-сайтов, программный код и математические задачи. Уже тогда Google открыто распространил весовые коэффициенты модели, разрешив свободное использование и модификацию — как в личных, так и коммерческих целях. Впоследствии появились специализированные варианты:

- CodeGemma для программирования,

- DataGemma для работы с данными,

- PaliGemma для обработки изображений и текста и т. д.

Параметры в нейросетях — это своего рода инструкции или правила, которые они используют для обработки информации и принятия решений. Например, чтобы отличить яблоко от апельсина. Чем больше параметров у нейросети, тем сложнее она может быть и тем точнее она сможет распознавать сложные закономерности, но при этом потребует больше ресурсов для обучения и работы.

Gemma 2 выпустили летом 2024. Она стала значительно мощнее: ее большая версия содержала уже 27 млрд параметров и отличалась лучшей производительностью и безопасностью по сравнению с предшественницей. По заявлениям Google, Gemma 2 обеспечила рекордную скорость работы на разных аппаратных платформах и стала одним из наиболее эффективных open-source решений в своем классе.

Новую Gemma 3 представили 12 марта 2025 года. К моменту ее выхода предыдущие версии семейства Gemma суммарно скачали свыше 100 миллионов раз, а энтузиасты создали около 60 тысяч собственных вариаций модели для разных задач. Поэтому третья версия модели сразу привлекла внимание разработчиков. Опираясь на опыт сообщества, создатели Gemma 3 внедрили в третью версию самые востребованные функции — больший объем контекста, поддержку мультимодальности и многое другое.

Технические характеристики Gemma 3 и принципы работы

Архитектура и параметры

Gemma 3 — это нейросетевая модель на основе архитектуры Transformer, аналогичной применяемой в GPT-4 и других LLM. Модель выпускается в нескольких вариациях по размеру: на 1 млрд, 4 млрд, 12 млрд и 27 млрд параметров. Даже 27 млрд — это относительно небольшое количество параметров по меркам флагманских ИИ (для сравнения: GPT-3 содержала 175 млрд параметров, а GPT-4, по некоторым данным, может достигать 1 трлн параметров). Но, несмотря на это, Gemma 3 демонстрирует высокую эффективность благодаря оптимизации в обучении.

Контекст и мультиязычность

Одно из ключевых улучшений — резко увеличенное окно контекста. Gemma 3 способна учитывать при генерации до 128 тысяч токенов входных данных. Для понимания масштаба: это примерно 100–120 тыс. слов, то есть модель может проанализировать целую книгу или большое количество документов за один запрос. Такой объем контекста значительно превышает стандартные 8–32 тыс. токенов у GPT-4 и даже превосходит рекордное окно в 100 тысяч токенов у модели Claude 2 от Anthropic. На практике это означает, что Gemma 3 может работать с длинными контрактами, отчетами или перепиской целиком, сохраняя всю историю разговора. Кроме того, в Gemma 3 реализована полноценная мультиязычность — новая токенизационная система позволяет понимать тексты более чем на 140 языках. Ранее модели Gemma были в основном англоцентричными, и добавление мультиязыковой поддержки существенно расширяет области применения (например, для создания многоязычных чат-ботов или перевода).

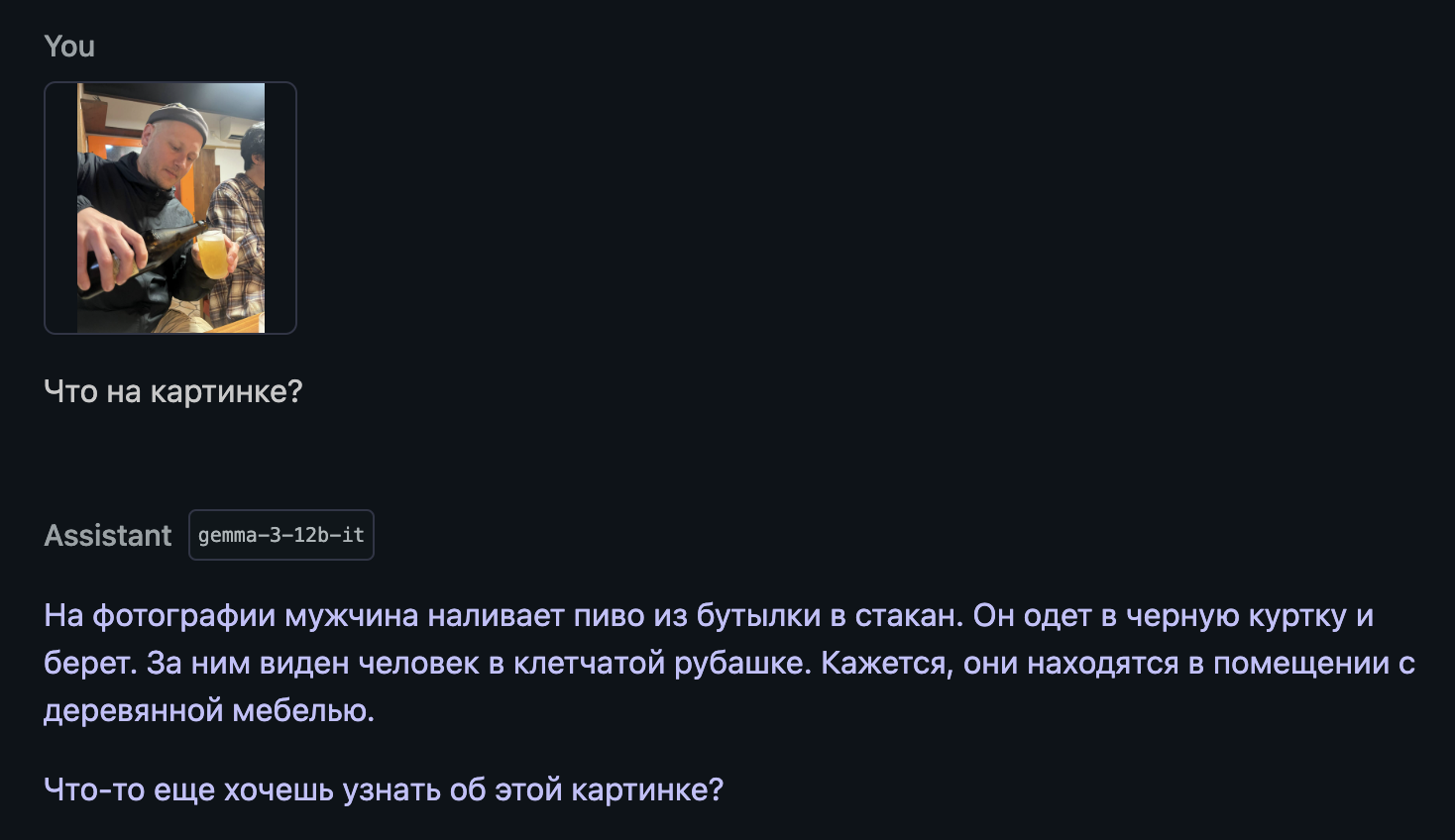

Мультимодальность

Еще одно новшество — Gemma 3 стала мультимодальной моделью. Это значит, помимо текста на вход она воспринимает изображения и видеофрагменты и способна анализировать их содержимое. В состав модели интегрирован модуль компьютерного зрения (визуальный энкодер на базе технологии SigLIP), позволяющий загружать изображения практически произвольного разрешения (адаптивный алгоритм сегментации разобьет слишком большие картинки на части). В результате Gemma 3 может обрабатывать задачи, совмещающие текст и визуальную информацию. Например, модель способна распознавать объекты на фото, отвечать на вопросы по картинке, сравнивать два изображения или читать текст, содержащийся внутри изображения (OCR). Разработчики демонстрировали, как Gemma 3 по фотографии панели климат-контроля с японскими надписями определила, какая кнопка отвечает за режим обогрева. Такие возможности приближают Gemma 3 к уровню GPT-4, у которого также есть мультимодальная версия, однако в случае Gemma все эти функции доступны открыто для всех пользователей локально — прямо на их устройствах.

Обучение и технологии

Gemma 3 обучалась на колоссальных объемах данных. В сумме модель «проглотила» триллионы токенов текстов: для младшей 1B версии — около 2 трлн токенов, для 4B — 4 трлн, 12B — 12 трлн, а самая крупная 27B — порядка 14 трлн токенов. Обучение проводилось на суперкомпьютерах Google с использованием TPU (Tensor Processing Unit) и библиотеки JAX. Ключевой особенностью стало сочетание нескольких методов дообучения (так называемый этап post-training) для повышения качества ответов. Во-первых, применялся дистилляционный метод — знания более крупной и мощной модели-инструктора были «переложены» в весовые коэффициенты Gemma 3.

Во-вторых, использовано обучение с подкреплением от обратной связи человека (Reinforcement Learning from Human Feedback, RLHF) — модель дообучили на основе оценок качества ответов, выставляемых людьми, чтобы ответы соответствовали человеческим предпочтениям.

В-третьих, внедрено обучение с подкреплением от обратной связи моделей (RLMF) для улучшения математических навыков: Gemma обучалась решать задачи, получая сигнал от внешних алгоритмов проверки решений, что повысило ее способность к расчетам и логическим рассуждениям.

Наконец, четвертый метод — обучение с подкреплением от выполнения кода (RLEF): модель генерировала фрагменты программ, запускала их и училась на результатах исполнения, что значительно развило ее умение писать правильный код.

Производительность

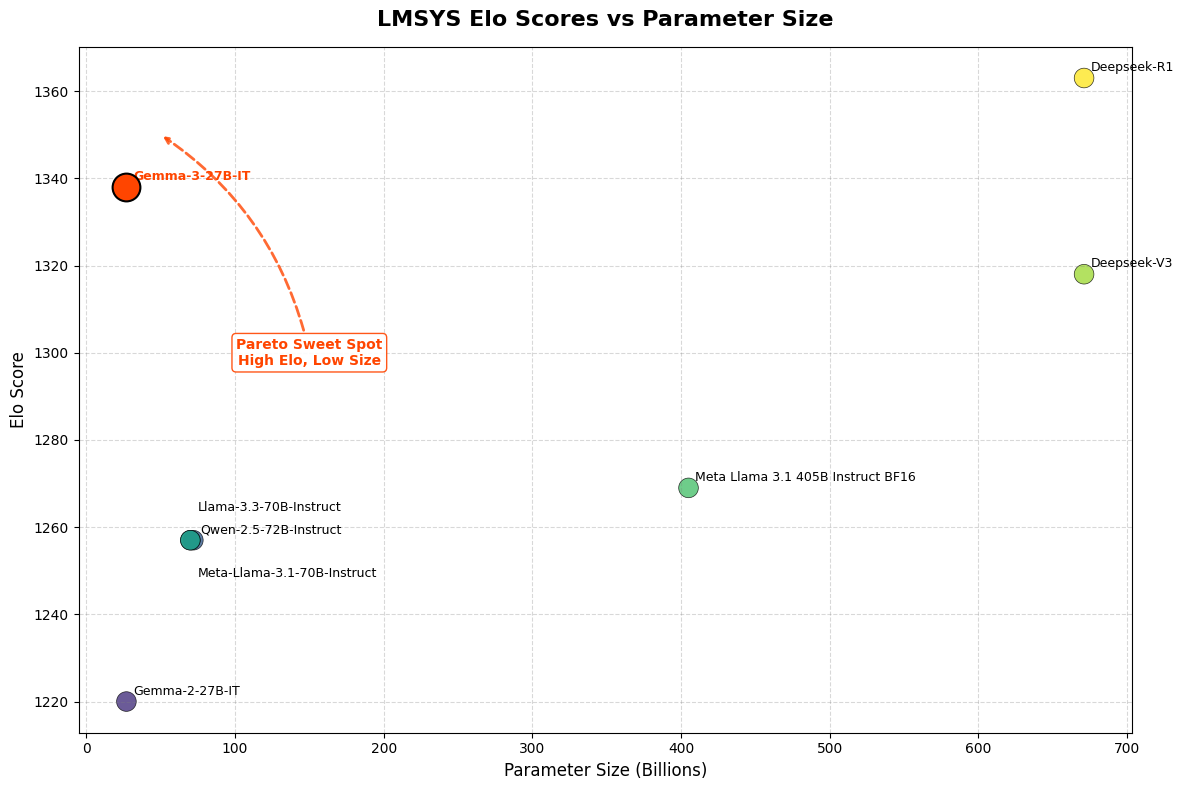

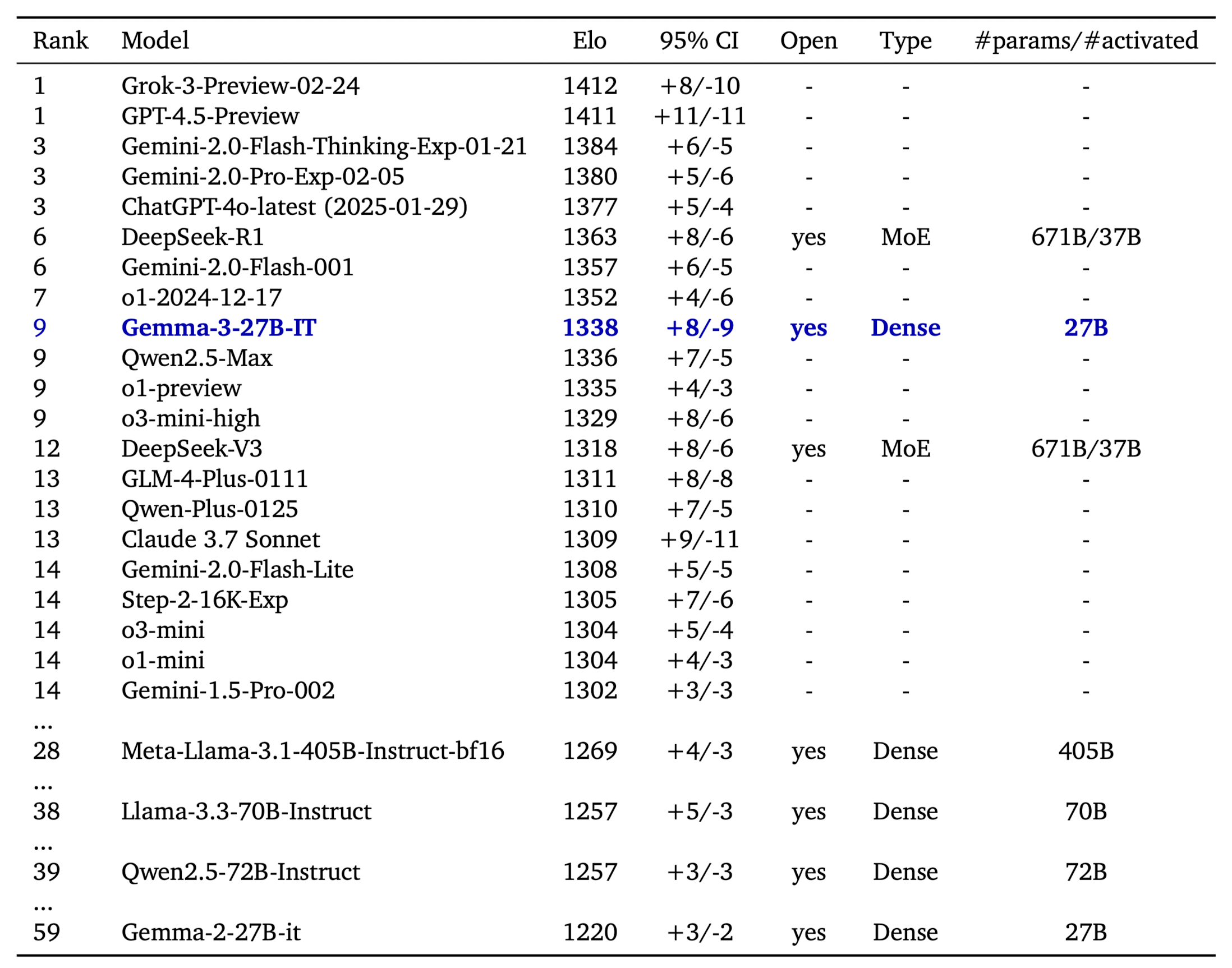

Согласно внутренним тестам и независимым рейтингам, Gemma 3 сегодня является одним из лидеров среди открытых компактных моделей. В открытом соревновании LMArena она заняла первое место в своей категории, набрав свыше 1330 баллов и опередив другие модели сопоставимого размера. По совокупности навыков (понимание языка, логика, креативность) Gemma 3 приближается к возможностям более крупных закрытых систем. Хотя напрямую конкурировать с громадными моделями вроде GPT-4 она не может из-за разницы в масштабах, по показателю «качество/размер» Gemma 3 задает фактически новый стандарт в индустрии.

Применение Gemma 3 в различных сферах

Универсальный языковой ассистент

Gemma 3 — это по сути универсальный чат-бот/ассистент, которого можно настроить под разные нужды. Как и другие LLM, эта модель подходит для построения диалоговых систем: ее можно интегрировать в сервис поддержки клиентов, виртуального помощника на сайте или голосового ассистента. Благодаря обучению на огромном корпусе текстов, Gemma понимает разговорный язык, отвечает на вопросы, умеет перефразировать и давать пояснения. В отличие от узкоспециализированных ботов с ограниченными сценариями, модель Gemma генерирует ответы самостоятельно, поэтому способна обрабатывать неожиданные запросы. Компании могут использовать ее для чат-ботов в техподдержке и колл-центрах, которые будут отвечать клиентам на естественном языке 24/7. При должной настройке (например, обучении на базе диалогов компании) такой бот сможет консультировать клиентов, бронировать услуги, решать распространенные проблемы без участия человека.

Генерация и обработка текста

Еще одна область применения — автоматизация рутинной работы с текстами. Gemma 3 умеет генерировать связный текст практически на любую тему — от кратких заметок и описаний товаров до объемных статей. Это можно использовать в маркетинге (создание черновиков рекламных материалов, постов для соцсетей), в журналистике (подготовка справок, черновых обзоров) или в бизнесе (написание писем и отчетов). Модель также хорошо справляется с редактированием и корректурой: ее можно попросить улучшить стиль текста, найти ошибки, упростить формулировки. Для исследователей будет ценна способность Gemma отвечать на вопросы по тексту и находить информацию. Например, она способна читать длинный документ и затем отвечать на вопросы, извлекая из него нужные факты (в силу большого окна контекста). Также Gemma 3 применима для суммаризации — автоматического составления краткого резюме длинного текста, будь то новостная статья, научная работа или юридический контракт. Это востребовано в аналитических отделах компаний и медиа: модель может за секунды подготовить выжимку ключевых пунктов из многостраничного отчета.

Образование и коммуникации

В сфере образования такие модели открывают новые возможности для обучения. Gemma 3 может выступать в роли интерактивного репетитора или справочного помощника для студентов. Она способна объяснять сложные концепции простым языком, отвечать на уточняющие вопросы, приводить примеры. Ученики могут практиковаться с ней в диалогах на иностранном языке — модель поддерживает множество языков и будет отвечать и исправлять ошибки собеседника. Кроме того, Gemma может генерировать тестовые вопросы или задачи по учебному материалу, помогая преподавателям. В корпоративном обучении ее можно применять для имитации диалогов с клиентами или тренировки сотрудников в решении тех или иных ситуаций.

Программирование и IT

Благодаря сильным навыкам кодогенерации, Gemma 3 может быть востребована среди разработчиков как ассистент по программированию. Ее обученная версия CodeGemma уже применялась для автодополнения кода и ответа на вопросы по языкам программирования. Даже базовая Gemma 3 может писать код на популярных языках (Python, JavaScript, C++ и др.), находить ошибки и предлагать исправления. Программист может описать на естественном языке, какую функцию он хочет реализовать, и модель предложит готовый шаблон кода. Она же способна объяснить чужой код, сгенерировать комментарии или написать тесты. Интегрировав Gemma в среду разработки (IDE), можно получить мощный инструмент, ускоряющий работу и помогающий избегать ошибок. В сфере анализа данных модель может генерировать SQL-запросы по описанию или даже выполнять простейший анализ данных в текстовом формате.

Обработка изображений мультимедиа

Gemma 3 способна анализировать и изображение, что делает эту версию модели применимой в новых сферах. Например, в e-commerce модель можно научить автоматически описывать изображения товаров для каталога, распознавать атрибуты (цвет, форма, бренд по логотипу). В медицине после соответствующего дообучения перспективно использование Gemma для анализа снимков (например, рентгенов или МРТ) в качестве подсказки врачу — модель может отмечать на изображении аномалии и пояснять их на естественном языке.

В системах безопасности ИИ-модель способна анализировать видео с камер: описывать происходящее, обнаруживать нестандартные ситуации. Для людей с ограничениями по зрению такая технология может описывать, а в сочетании с другими моделями — и озвучивать содержание изображений или интерфейсов, повышая доступность цифровой среды. Кроме того, Gemma 3 может совместно обрабатывать текст и изображение — например, пользователь может прикрепить фотографию документа, и модель прочитает (распознает текст) и кратко перескажет его содержание. Такая форма взаимодействия может найти применение в делопроизводстве, юриспруденции (быстрый анализ сканов договоров) и других отраслях.

Специализированные приложения

Благодаря открытости семейства Gemma, исследователи по всему миру адаптируют эти модели под узкие задачи. Например, команда из Принстонского университета разработала методику SimPO для тонкой настройки Gemma под человеческие предпочтения. Болгарский институт INSAIT обучил модель на локальном языке, получив одну из самых точных языковых моделей для болгарского. Стартап Nexa внедрил Gemma в аудиосферу (проект OmniAudio), научив модель работать с аудио-модальностями.

Сравнение Gemma 3 с другими моделями (GPT-4, Claude, LLaMA и другие)

На рынке ИИ-моделей сегодня присутствует несколько заметных игроков: OpenAI GPT-4, Anthropic Claude 2, а также от открытых моделей вроде LLaMA 2 от Meta (признана в России экстремистской организацией и запрещена).

Gemma 3 vs GPT-4

GPT-4 — одна из самых мощных коммерческих моделей ИИ на сегодняшний день. По оценкам экспертов, ее архитектура может насчитывать сотни миллиардов или даже триллионы параметров, что существенно больше максимальных 27 млрд у Gemma 3. Больший размер и огромный объем обучающих данных дают GPT-4 превосходство в ряде сложных задач: эта модель демонстрирует выдающиеся результаты в тестах на эрудицию, решении олимпиадных задач, прохождении профессиональных экзаменов и т. д.

Тем не менее, Gemma 3 в некоторых сферах способна сократить разрыв в качестве за счет продвинутого обучения. По некоторым независимым оценкам, лучшая версия Gemma (27B) на открытых тестовых платформах практически сравнялась по качеству ответов с GPT-4. Конечно, в самых трудных сценариях (например, требующих глубокой логики или знаний нишевых фактов) GPT-4 пока впереди. Но Gemma 3 выигрывает в доступности и гибкости. В отличие от закрытого GPT-4, работающего только через API OpenAI, модель Gemma можно запустить локально, изменить под свои нужды, встроить в продукт без ограничений и платы за каждое обращение. Еще один козырь Gemma 3 — окно контекста 128 тыс. токенов, тогда как базовый GPT-4 изначально поддерживал 8 тыс., а расширенная версия — до 32 тыс. токенов. Кроме того, мультимодальные возможности Gemma доступны «из коробки» всем пользователям, тогда как у GPT-4 доступ к анализу изображений ограничен и контролируется OpenAI.

Gemma 3 vs Claude 2

Модель Claude 2 разработана специалистами Anthropic (стартап основан выходцами из OpenAI). Она известна акцентом на безопасности и этичности ответов. По объему параметров она оценивается примерно в десятки миллиардов (точное число не раскрывалось), что сопоставимо с Gemma 3. Claude заработала репутацию «менее токсичной» модели, старательно избегающей нежелательного контента. Gemma 3 в ответ внедрила собственные меры безопасности: фильтрацию данных при обучении и систему дополнительных моделей-модераторов. Например, одновременно с Gemma 3 был выпущен модуль ShieldGemma 2 — отдельная модель-классификатор на 4 млрд параметров, обученная отслеживать и маркировать нежелательный контент в изображениях. Такой модуль можно ставить «на входе» Gemma 3, чтобы она не обрабатывала неприемлемые картинки, а на выходе — чтобы проверять генерируемый текст.

В плане возможностей Claude 2 и Gemma 3 во многом сходны: обе поддерживают длинный контекст (у Claude 2 — до 100 тыс. токенов, у Gemma 3 — 128 тыс.), умеют вести диалог, писать код. Отличие в том, что Claude 2 — закрытая коммерческая модель (доступна через ограниченный API, например в рамках платформы AWS), тогда как Gemma 3 полностью открыта. Это значит, что Gemma можно развернуть внутри корпоративной инфраструктуры, что важно для компаний, которым критична приватность данных без передачи информации внешнему API.

Производительность этих моделей также близка: Claude 2 также весьма «умна» и при выборе многое зависит от контекста: если необходима максимальная предсказуемость и безопасность — Claude может быть предпочтительнее, если ценится контроль и кастомизация — Gemma станет хорошим выбором.

Gemma 3 vs LLaMA 2

LLaMA 2 — открытая модель от Meta, которая появилась в 2023 году. Ее часто называли главным конкурентом открытых моделей Google. LLaMA 2 доступна в размерах 7, 13 и 70 млрд параметров. Таким образом, максимальная версия LLaMA 2 больше, чем Gemma 3, что теоретически дает ей преимущество в сложности представлений. На практике же сравнение зависит от конкретных метрик. Gemma 3 благодаря продвинутому обучению показывает лучшие результаты на единицу размера модели. Так, версия Gemma 3 с 27B параметров по ряду тестов конкурирует с LLaMA 2 70B и превосходит LLaMA 2 13B.

Кроме того, Gemma 3 заметно превосходит LLaMA 2 по функциональности. Во-первых, мультимодальность: базовая LLaMA 2 работает только с текстом, и хотя для нее существуют сторонние расширения для картинок, изначально она не «видит» изображения. Gemma же сразу «из коробки» понимает визуальный контент. Во-вторых, контекст: у моделей LLaMA стандартное окно контекста около 4 тыс. токенов, и лишь экспериментальные версии увеличивали его до ~32 тыс., тогда как Gemma 3 имеет встроенные 128 тыс. токенов. В-третьих, Gemma лучше готова к диалоговому взаимодействию с пользователем: ее -it варианты натренированы на больших массивах человеческих диалогов и предпочтений (RLHF) , тогда как LLaMA 2 предлагает только базовые модели и чат-версии с ограниченным обучением на человеческих отзывах.

С другой стороны, LLaMA 2 была выпущена под лицензией, разрешающей коммерческое применение, и уже успела обзавестись огромным количеством модификаций (например, специализированные чат-боты вроде Vicuna, WizardLM и пр.). Сообщество вокруг LLaMA активно создавало версии для разных задач в 2023–2024 годах. Однако появление Gemma несколько изменило расклад: Google предоставила не менее открытую альтернативу с лучшей оптимизацией. Можно сказать, что Gemma 3 — это ответ Google на LLaMA 2 и последующие открытые модели.

Прочие модели

Помимо вышеперечисленных, существует множество других языковых моделей. Например, PaLM 2 от того же Google (движок чат-бота Bard) — мощная мультиязычная модель, но она закрыта и доступ к ней ограничен API. Специализированные открытые модели вроде Mistral 7B (от одноименного французского стартапа) также претендуют на высокие результаты при малом размере. Однако Gemma 3 выгодно отличается тем, что совмещает более широкие универсальные возможности и открытость. По сути, Google впервые выпустила настолько функционально насыщенную модель (с поддержкой изображений, многих языков, длинного контекста) в открытый доступ. Это и выделяет Gemma 3 на фоне аналогов и делает ее привлекательной для разработчиков.

Ограничения и недостатки Gemma 3

Несмотря на все достижения, у Gemma 3 есть и ограничения — как технические, так и концептуальные. Во-первых, остается ограничение качества ответов, связанное с относительно небольшим размером модели. Разработчики максимизировали эффективность Gemma, но 27 млрд параметров — это все же в десятки раз меньше, чем у самых больших моделей. Поэтому на чрезвычайно сложных задачах Gemma 3 может уступать: например, спутать факты в вопросах, требующих цепочки рассуждений, или дать менее развернутый ответ там, где GPT-4 блистает глубиной. Временами модель все еще склонна к галлюцинациям — то есть уверенно сообщать ложную информацию. Это болезнь всех крупных языковых моделей: они генерируют текст на основе статистической вероятности и могут «выдумывать» убедительно звучащие, но неверные утверждения. В Gemma 3 постарались нивелировать это с помощью обучения с человеческой обратной связью, но полностью проблему не устранили. Поэтому при использовании в критически важных областях (медицина, юриспруденция) выводы модели должны перепроверять эксперты.

Еще один момент — этические и социальные риски. Gemma 3 обучена на данных из интернета, что означает наличие определенных предубеждений и стереотипов, присутствующих в текстах. Разработчики фильтровали токсичный и экстремистский контент на этапе обучения и проводили оценки на предмет предвзятости. Однако полностью устранить риск того, что модель сгенерирует некорректный или оскорбительный ответ, невозможно. Особенно учитывая, что Gemma доступна всем: в отличии от закрытых моделей, где компании ставят контент-фильтры, открытая модель может быть модифицирована кем угодно. Это означает, что ответственность за использование Gemma во многом ложится на самих пользователей и разработчиков, внедряющих ее в свои продукты. Google публикует подробные карты модели (Model Card) с описанием ограничений и рекомендует тестировать ответы модели перед ее развертыванием. Например, если Gemma используется для автоматических ответов клиентам, нужно убедиться, что она не будет случайно генерировать неприемлемые реплики. Встроенная система ShieldGemma помогает снизить риски для визуального контента, но для текста разработчикам также стоит применять фильтры нежелательной лексики и мата, настройку уровня «строгости» ответов и т. д.

Еще одно ограничение — актуальность знаний модели. Gemma 3 обучена на массиве данных, который был собран до определенного времени (дата отсечения в данном случае — 2024 год). Это значит, что у модели могут отсутствовать сведения о совсем недавних событиях, именах или технологических новинках, появившихся после завершения ее обучения. Например, спросив у Gemma о событии, произошедшем неделю назад, пользователь рискует получить ответ, основанный на догадках, а не на реальных данных. Для решения этой проблемы часто применяют подход Retrieval-Augmented Generation (RAG) — когда модель дополнительно снабжают свежей информацией из баз знаний или поисковых систем при формировании ответа. В экосистеме Gemma тоже есть инструмент для этого (упомянутая модель DataGemma RAG), однако это требует дополнительной настройки.

Наконец, хоть Gemma 3 и оптимизирована для быстрой работы, аппаратные требования крупнейшей 27B версии все же ощутимы. Чтобы воспользоваться полным потенциалом (например, 128 тыс. токенов контекста), нужен сервер с десятками гигабайт видеопамяти. На среднем ноутбуке можно запустить только небольшие версии Gemma 3 (1B или 4B параметров) и получать ответы средней сложности. Для продвинутых задач может потребоваться видеокарта с достаточным объемом памяти (24 ГБ) или аренда облачной мощности. Таким образом, заявления разработчиков о «работе на любом устройстве» стоит воспринимать трезво: возможности масштабируются в зависимости от «железа».

Как эффективно использовать Gemma 3

Работа с большими языковыми моделями — это во многом искусство правильной постановки задач. Вот несколько рекомендаций, которые помогут получить от Gemma 3 лучшие результаты.

- Формулируйте четкие запросы. Постарайтесь максимально ясно описать задачу в сообщении модели. Вместо расплывчатого «Напиши что-нибудь про погоду» лучше задать конкретику: «Составь утренний прогноз погоды в шутливой форме для публикации в соцсетях». Чем понятнее и детальнее инструкция, тем более релевантным будет ответ.

- Используйте пошаговые инструкции. Если задача комплексная, разбивайте ее на этапы. Можно попросить Gemma сперва проанализировать условие, затем выполнять вычисления, потом дать выводы. Модель умеет следовать многоходовым сценариям и даже выполнять условный «план действий», если его прописать явно. Например, для сложной математической проблемы можно написать:

- Объясни, что требуется найти.

- Перечисли известные данные.

- Приведи формулы и вычисления.

- Дай итоговый ответ».

Такой структурированный подход направляет модель и улучшает качество решения.

- Приводите примеры. Gemma 3 умеет учиться на лету из примеров, приведенных прямо в тексте запроса. Если вам нужен ответ в определенном формате или стиле, покажите модели образец. Например, запрос может выглядеть так: «Требуется преобразовать фразы в вежливую форму. Пример: „Дай отчет„ → „Не мог бы ты предоставить отчет, пожалуйста?“. Теперь преобразуй: „Исправь ошибки“». В этом случае Gemma, увидев пример, продолжит в заданном стиле и выдаст: «Не мог бы ты обратить внимание на ошибки и исправить их?».

- Настройте тон и роль модели. В общении с Gemma можно описать определенную персону или стиль ответов, если это нужно. Например, начать запрос с установки контекста: «Представь, что ты опытный врач, объясняющий пациенту диагноз простыми словами…» или «Ты — помощник программиста, отвечаешь кратко и по делу…». Модель воспримет это как вводную и будет формировать ответы соответствующим образом. Этот прием полезен, чтобы ограничить излишне творческие отклонения модели и задать рамки ответа (официальный или наоборот дружеский тон, уровень подробностей и т. п.).

- Используйте внешние инструменты при необходимости. Хотя Gemma 3 сама по себе очень способна, она не всесильна. Ее можно интегрировать с другими программами для улучшения результатов. Например, для сложных расчетов или получения актуальных данных можно настроить цепочку: Gemma генерирует запрос, внешний калькулятор или база знаний выполняет вычисление/поиск, затем Gemma формирует ответ с учетом полученных данных. Такой подход (известный как ReAct prompting — совмещение рассуждений и действий) позволяет обойти возможные еограничения модели в математике или осведомленности. Google предлагает «рецепты» в Gemma Cookbook — специальном репозитории с примерами кода, демонстрирующими, как связать модель с различными инструментами. Использование Gemma в связке с утилитами существенно расширяет ее функциональность.

- Подбирайте версию модели. Если вы разработчик, имейте в виду, что Gemma 3 доступна в нескольких вариантах. Для быстрых экспериментов или развертывания на слабом устройстве можно взять малый (1B или 4B). Для русскоязычных или многоязычных задач — убедитесь, что используете новую токенизацию Gemma 3, оптимизированную под 140 языков (старые версии были слабее в этом плане). При работе с кодом стоит попробовать модель CodeGemma, которая обучена специально на программировании — она может давать более точные ответы на вопросы по коду и писать программы с учетом контекста задачи. Также доступен вариант Gemma 3 Instruct — модель, дообученная на диалогах и инструкциях; ее ответы будут более развернутыми и «человекоориентированными», чем у сырого предобученного варианта.

- Тестируйте и дообучайте при необходимости. Для узкоспециализированных задач (медицина, право, финансы) желательно провести дообучение модели на профильных данных или по крайней мере протестировать на типичных запросах. Gemma 3 позволяет делать тонкую настройку (fine-tuning) — вы можете дообучить модель на своих данных, добившись лучшего понимания вашей специфики. Если такой возможности нет, то хотя бы составьте список пробных вопросов по вашей области и проверьте, корректны ли ответы. В случае ошибок — можно применить техники, описанные выше (дать примеры правильных ответов, уточнить формулировки).

Где попробовать и как установить Gemma 3

Для тех, кто хочет познакомиться с моделью поближе, Google предоставила несколько вариантов доступа. Самый простой — веб-интерфейс Google AI Studio, где Gemma 3 доступна для экспериментов онлайн. На этой платформе можно в пару кликов начать диалог с моделью или испытать ее на своих задачах.

Энтузиасты могут скачать среду LM Studio, которая позволит скачать и установить подходящую версию Gemma 3 на компьютер под управлением MacOS, Windows или Linux.

Разработчикам стоит искать модель в репозиториях Hugging Face или Kaggle — это также позволит запустить Gemma 3 локально или на сервере.

| Pre Trained |

Instruction Tuned |

Мульти- модальность |

Много- язычность |

Окно контекста |

|---|---|---|---|---|

| gemma-3-1b-pt | gemma-3-1b-it | ❌ | английский | 32 тыс. |

| gemma-3-4b-pt | gemma-3-4b-it | ✅ | +140 языков | 128 тыс. |

| gemma-3-12b-pt | gemma-3-12b-it | ✅ | +140 языков | 128 тыс. |

| gemma-3-27b-it | gemma-3-27b-it | ✅ | +140 языков | 128 тыс. |