Еще в 2019 году новость о выпуске модели GPT второго поколения обсуждалась в основном профильными СМИ и экспертами. Сегодня люди используют большие языковые модели в профессиональной и повседневной жизни, а разработчики нейросетей предсказывают грандиозный скачок в их развитии в ближайшие пять лет.

Основные вехи развития нейросетей за последние пять лет

2019 год

14 февраля — компания OpenAI запустила самую большую на тот момент языковую модель GPT-2 с 1,5 млрд параметров. Она стала преемником первой модели-трансформера компании GPT-1 (Generative Pre‑trained Transformer). В такой модели обученный алгоритм принимает на вход один набор данных, а затем преобразовывает их в набор чисел. GPT-2 обучили предсказывать следующее слово в 40 Гб интернет-текста. Модель оказалась способной генерировать страницы связного текста, обобщать и переводить его.

2020 год

13 февраля — Microsoft запустила модель генеративного языка Turing Natural Language Generation с 17 млрд параметров. Она позиционировалась как инструмент для разных приложений, который позволяет обобщать содержимое разных текстовых документов: электронных писем, сообщений в блогах, документов Word, таблиц Excel и презентаций PowerPoint.

28 мая — OpenAI выпустила большую языковую модель GPT-3, состоящую из 175 млрд параметров. С ее выпуском исследователи решили проблему предобученных алгоритмов, которые требовали больших наборов данных. GPT-3 для выполнения каждой новой задачи требовалось всего несколько примеров. Модель научили отвечать на вопросы по прочитанному тексту, писать стихи, разгадывать анаграммы и переводить на разные языки. В итоге средняя точность ИИ в разных задачах составила 60%.

30 ноября — DeepMind заявила, что ее версия системы искусственного интеллекта AlphaFold помогла решить 50-летнюю задачу фолдинга (прогнозирования структуры) белка. В ее основе лежит нейросеть с архитектурой трансформера, как и в языковых моделях. Система дала надежные прогнозы базовой физической структуры белка за считаные дни, в том числе белковых структур вируса SARS-CoV-2.

2021 год

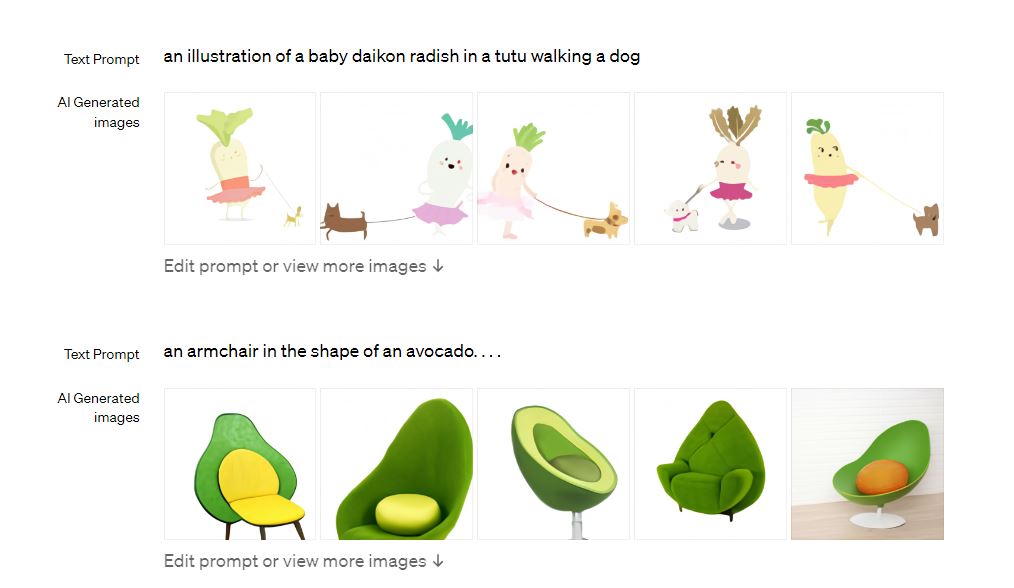

5 января — OpenAI представила первый генератор изображений по текстовым описаниям Dall-E. Он базировался на архитектуре GPT-3. Генератор позволял создавать абстрактные картинки и достраивать их.

18 мая — Google презентовала языковую модель для диалоговых приложений LaMDA. Ее обучали на разнообразных данных, чтобы с ИИ можно было общаться не только текстом, но и с помощью медиафайлов.

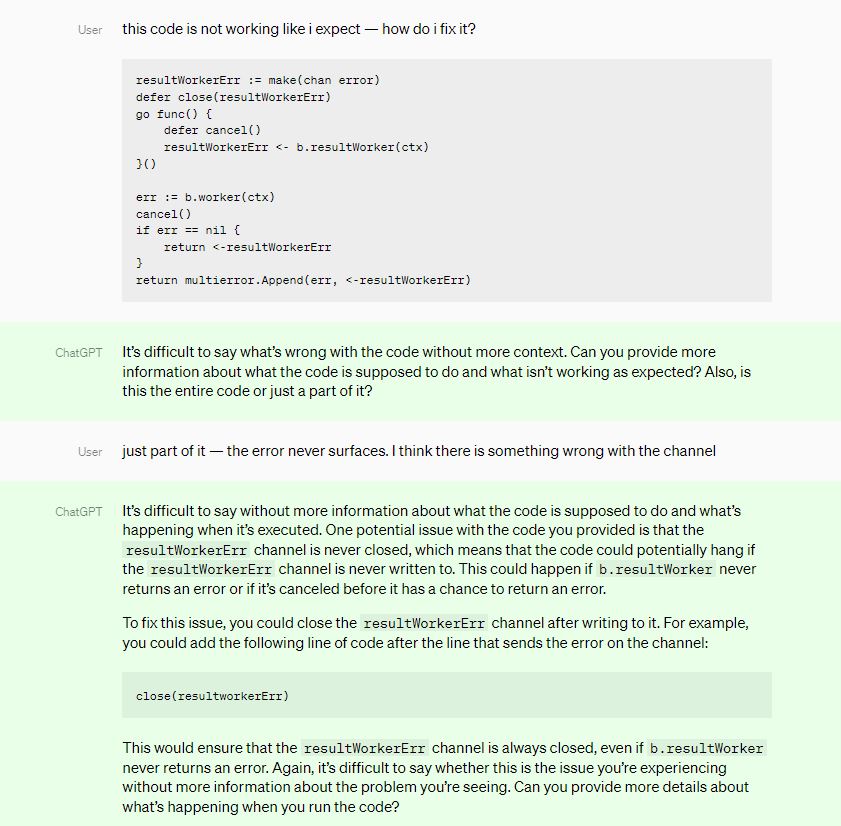

29 июня — платформа для разработчиков GitHub и OpenAI представили ИИ-помощника Copilot для помощи программистам в написании кода. Он базировался на модели OpenAI Codex — модифицированной версии GPT-3. Инструмент генерирует код по текстовому запросу, переводит его с одного языка программирования на другой, ищет ошибки в коде, предлагает улучшения и т.д. Copilot обучали на общедоступных репозиториях GitHub.

18 ноября — OpenAI открыла интерфейс генератора текстов GPT-3 для разработчиков. Это позволило начать создавать первые потребительские приложения с ИИ.

2022 год

4 апреля — Google AI Research представила новую языковую модель Pathways Language Model (PaLM). Она включала в себя более 540 млрд параметров и научилась понимать сложные понятия и взаимосвязи. Модель была способна объяснять шутки, логически рассуждать, пояснять свои действия и писать код.

11 июня — инженер-программист Google Блейк Лемуан, который работал с языковой моделью LaMDA компании, заявил, что ИИ обладает признаками собственного сознания. После этого корпорация уволила его.

5 октября — разработанная компанией DeepMind система искусственного интеллекта AlphaTensor с архитектурой нейросети на основе трансформера предложила более быстрый способ умножения матриц. Она по-новому решила фундаментальную математическую задачу впервые более чем за 50 лет. ИИ базировался на модели AlphaZero, которая предназначалась для настольных игр. Задача об умножении матриц лежит в основе самых разных процессов — от вывода изображения на экран до моделирования сложной физики и обучения ИИ. Ее решение позволило оптимизировать выполнение таких задач и сэкономить энергию на вычислениях.

30 ноября — OpenAI выпустила чат-бот ChatGPT на базе языковой модели GPT-3.5. Он был способен писать код, выдавать финансовый анализ, сочинять стихи и песни, создавать тексты и рефераты, делать резюме технических статей или научных концепций, давать персональные советы и ответы на вопросы из разных сфер.

2023 год

14 марта — OpenAI представила первую мультимодальную модель искусственного интеллекта GPT-4, которая способна распознавать текст, картинки, аудио и видео.

22 марта — тысячи исследователей ИИ, а также бизнесмены Илон Маск и Стив Возняк призвали приостановить обучение систем мощнее GPT-4 минимум на полгода.

24 апреля — «Сбер» выпустил мультимодальную нейросеть GigaChat, которая умеет отвечать на вопросы пользователей, поддерживать диалог, писать код, создавать тексты и картинки на основе описаний.

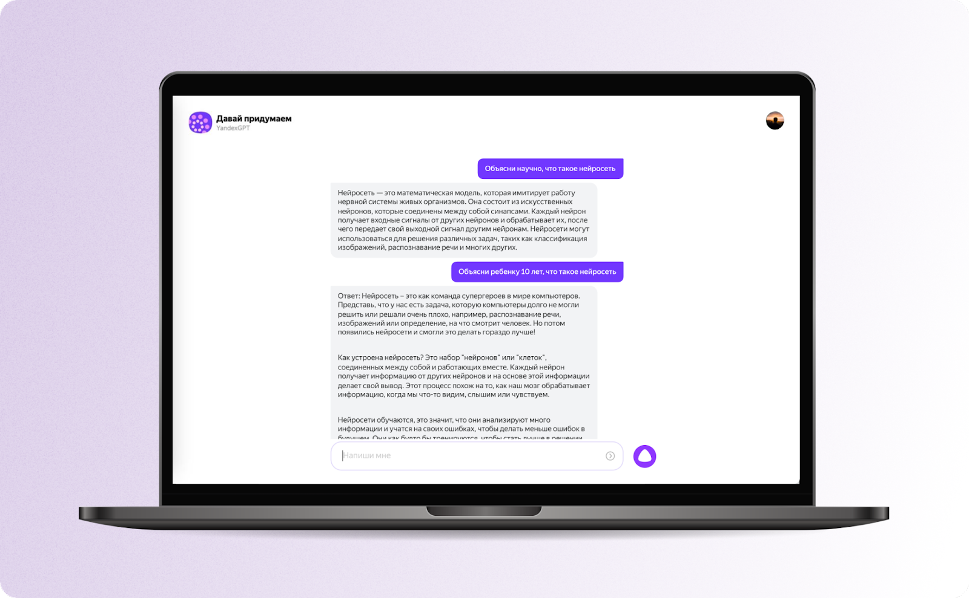

17 мая — «Яндекс» представил нейросеть YandexGPT (YaGPT) и добавил его поддержку в виртуального ассистента «Алису».

15 августа — Китай принял свод руководящих принципов разработки и контроля за ИИ.

7 сентября — «Яндекс» выпустил второе поколение нейросети YaGPT. Она научилась лучше генерировать и анализировать тексты, отвечать на вопросы и предлагать идеи.

25 сентября — в ChatGPT внедрили функции распознавания и генерации голоса, а также распознавания изображений. Кроме того, сервис обновили прямыми ссылками на источники, и теперь он не ограничивается данными до сентября 2021 года.

30 октября — президент США Джо Байден подписал указ об ответственном развитии и регулировании ИИ.

7 ноября — OpenAI представила версию GPT-4 Turbo. Ее базу знаний обновили до апреля 2023 года, а сам ИИ смог принимать запросы в объеме до 300 страниц. Тогда же компания анонсировала конструктор чат-ботов GPTs, с помощью которого пользователи могут включать в ChatGPT специальные возможности, специфические знания и навыки.

6 декабря — Google представила семейство языковых моделей Gemini. Это мультимодальные модели, которые отличаются от GPT тем, что работают на базе единого алгоритма для распознавания разных данных. В Google заявили, что самая мощная модель Gemini Ultra превзошла GPT-4 в 30 из 32 тестов производительности, в том числе в рассуждении и распознавании изображений.

11 декабря — Европарламент утвердил AI Act, первый в регионе закон о регулировании искусственного интеллекта.

2024 год

10 января — OpenAI запустила GPT Store, где разработчики могут размещать свои приложения на базе ChatGPT.

15 февраля — OpenAI представила первую нейросеть Sora, которая способна генерировать реалистичные ролики длиной до минуты.

15 февраля — Google выпустила модель Gemini 1.5, которая способна принимать на ввод большие массивы информации, например 402-страничные стенограммы миссии «Аполлона-11» на Луну, 44-минутный немой фильм Бастера Китона или более чем 100 тыс. строк кода.

15 февраля — президент России Владимир Путин подписал указ об обновлении стратегии развития ИИ до 2030 года. Он включает положение о прозрачности и объяснимости работы систем.

25 марта — Google открыла доступ к Gemini 1.5 и интерфейс для разработчиков приложений.

28 марта — «Яндекс» презентовал линейку нейросетей YandexGPT 3. YandexGPT 3 Pro лучше работает со сложными запросами, а дообучить ее можно самостоятельно. Кроме того, нейросеть можно встроить в продукты бизнеса через API.

Директор по развитию технологий искусственного интеллекта «Яндекса» Александр Крайнов:

«Развитие технологий ИИ за последние годы впечатляет. В первую очередь за счет генеративного ИИ и в особенности больших текстовых моделей. Я бы сказал, что поворотным пунктом было появление моделей архитектуры трансформеров. Также стоит отметить появление диффузионных моделей, которые вывели генерацию изображений по тексту на качественно новый уровень».

Какими были ожидания относительно нейросетей

За последние годы множество исследователей, визионеров и бизнесменов делали прогнозы относительно развития нейросетей. Если проанализировать их, то становится ясно, что даже те, кто работает над этими технологиями, не всегда могли предвидеть скорость их развития.

Так, в ходе презентации Dall-E в 2021 году ученый-информатик, соучредитель OpenAI Илья Суцкевер заявил: «В долгосрочной перспективе появятся модели, которые понимают и текст, и изображения. ИИ сможет лучше понимать язык, потому что он сможет видеть, что означают эти слова и предложения». Однако его компания выпустила первую мультимодальную модель — GPT-4 — спустя всего два года. Недооценивал скорость развития технологии и научный директор Мила-Квебекского института искусственного интеллекта Йошуа Бенгио. В 2019 году он говорил, что за два десятилетия исследователям «не удалось даже приблизить ИИ к уровню развития интеллекта двухлетнего ребенка». Ученый сомневался в том, что инструменты ИИ в виде виртуального помощника или чат-бота можно будет успешно использовать для решения задач в ближайшем будущем.

Но были и те представители науки и бизнеса, которые дали более точные прогнозы и одними из первых начали внедрять технологии в практическую сферу. «Идеальная поисковая система понимала бы все на свете. Она поймет все, о чем вы спрашиваете, и мгновенно выдаст именно то, что нужно. Вы могли бы задать ей вопрос: «Что мне спросить у Ларри?» И она ответила бы», — рассуждал о будущем поисковиков сооснователь Google Ларри Пейдж еще в 2006 году. На сегодняшний день Google и Microsoft уже предлагают встроенные в свои поисковики «умные» функции.

Тайваньский предприниматель и инвестор Кай-Фу Ли в середине 2010-х так же точно подмечал, чем обернутся усилия IT-корпораций в расширении доступа к технологиям ИИ: «Мне очень интересна постепенная платформизация. Усилия Google, Amazon, Salesforce — они сводят ИИ до уровня, когда не нужно быть экспертом, чтобы его использовать. Я думаю, что день, когда любой хороший инженер-программист сможет программировать ИИ, станет поворотной точкой для его широкого распространения». Его мысль в 2018 году дополнила управляющий партнер Grant Thornton LLP Николь Джордан, которая выразила уверенность, что «для внедрения ИИ больше не потребуется многомиллионный бюджет, и это сделает правила игры равными для небольших компаний». Действительно, к 2024 году крупные компании не только предлагают недорогие решения с ИИ по подписке, но и разработали инструменты создания чат-ботов, которые не требуют навыков программирования.

Роль технологий для потребителей в 2019 году предсказала аналитик в сфере ИИ Эми Стэплтон: «Мы вступаем в новый мир. Технологии машинного обучения, распознавания речи и понимания естественного языка достигают вершины возможностей. Конечным результатом является то, что вскоре у нас появятся помощники с искусственным интеллектом, которые будут помогать нам во всех аспектах нашей жизни». В наши дни популярность чат-ботов растет, а ведущие поставщики софта предлагают продукты для компаний со встроенным ИИ.

Ученый-информатик, доцент Стэнфорда Эндрю Ын в 2017 году дал более общий прогноз, который уже начинает сбываться. Он отметил: «Трудно представить крупную отрасль, которую ИИ не сможет трансформировать. Это в том числе здравоохранение, образование, транспорт, розничная торговля, связь и сельское хозяйство. Точно так же, как 100 лет назад появление электричества изменило почти все, не будет отраслей, на которые ИИ не повлияет в ближайшие несколько лет».

Были правы и те, кто обращал внимание на проблему отсутствия регулирования и прозрачности систем ИИ. Так, профессор Массачусетского технологического института Макс Тегмарк в 2017 году говорил, что нужно разрабатывать доверенный искусственный интеллект, чьи решения будут понятны людям. Уже сейчас этим занимаются компании и сообщества, которые разрабатывают системы с открытым кодом и датасетами обучения, такие как Llama от Meta (признана экстремистской, ее деятельность запрещена в России). А гендиректор O'Neil Risk Consulting and Algorithmic Auditing Кэти О’Нил в 2019 году обращала внимание на предвзятость алгоритмов и призывала регуляторов создавать нормативные базы для их контроля. Первые законы в области ИИ содержат пункты о непредвзятом обучении ИИ.

Александр Крайнов же говорит, что регуляторные преграды могут стать самым серьезным препятствием на пути внедрения ИИ: «Неудачная регуляторика может серьезно замедлить или даже остановить применение технологий, лишив людей новых возможностей и поставив их в невыгодное положение по сравнению с теми, у кого эти возможности есть». Он также отмечает, что в России ситуация с законодательством неплохая: «Выбранная модель саморегулирования, или, говоря другими словами, мягкого права, показывает свою высокую эффективность в условиях текущего быстрого прогресса».

Прогнозы на ближайшие пять лет

Целый ряд визионеров, предпринимателей и исследователей считают, что ближайшие пять лет станут важнейшим этапом в развитии искусственного интеллекта и, возможно, мы увидим первые шаги в направлении общего ИИ (AGI). Так, например, считает генеральный директор Nvidia Дженсен Хуанг. Он видит реальным появление компьютеров, которые могут думать как люди: «Если бы я дал ИИ каждый тест, какой вы только можете себе представить, то через пять лет мы преуспеем в каждом из них». На данный момент ИИ уже способен сдавать экзамены на адвоката, но испытывает трудности с прохождением специализированных медицинских тестов, например по гастроэнтерологии.

Сооснователь Microsoft Билл Гейтс тоже оптимистично настроен в отношении искусственного интеллекта. Он предсказывает, что ИИ облегчит жизнь каждому человеку уже в ближайшие пять лет, а особенно полезен будет врачам в рутинной работе. Так, ChatGPT, по мнению визионера, сможет работать репетитором, давать советы по здоровью, помогать писать код и применяться в технической поддержке. Гейтс уверен, что люди будут общаться с ИИ через обычные смартфоны.

А соучредитель DeepMind Мустафа Сулейман говорит, что в ближайшие пять лет передовые компании будут обучать модели, которые в тысячу раз больше GPT-4. Они, как отмечает бизнесмен, будут чрезвычайно способными личными помощниками, а также станут широко применяться в науке — например, для открытия реакции синтеза, которая позволит получить неограниченный объем энергии.

Аналогичной точки зрения придерживается и Александр Крайнов из «Яндекса». Он полагает, что развитие технологий ИИ не только не приведет к исчезновению многих профессий, но вызовет появление новых, например AI-тренеров. По мнению эксперта, уже сейчас очевидно, что генеративный ИИ смогут использовать врачи, юристы, программисты, писатели, журналисты и дизайнеры. «Но мы сейчас и близко не осознали все открывшееся возможности — буквально каждый день приносит интересные новости и свежие идеи», — говорит Александр Крайнов.

Один из пионеров искусственного интеллекта и обладатель премии Тьюринга Джеффри Хинтон настроен в отношении ИИ более радикально. В 2023 году он даже покинул пост вице-президента Google, чтобы предупредить человечество об опасностях технологии. Хинтон считает, что ИИ может стать умнее людей уже в течение пяти лет благодаря развитию больших языковых моделей. Исследователь говорит, что современные ведущие модели ИИ уже обладают подлинным интеллектом и способностями к рассуждению, а потенциально могут получать и собственный опыт подобно людям. Хинтон допускает, что со временем системы ИИ будут обладать сознанием. В этой связи он предостерегает от спешки в обучении более продвинутых моделей. Хинтон указывает сразу на несколько рисков «гонки ИИ»: резкий рост дезинформации, потеря рабочих мест и даже появление автономного оружия, которое может уничтожить человечество.

Александр Крайнов же отмечает, что не верит в появление общего ИИ (AGI) через пять лет. Он также допускает, что само понимание этого понятия изменится и AGI «начнут называть что-то относительно простое».

Между тем ученые, которые занимаются вопросами обучения ИИ, задаются и другими вопросами. Они указывают на парадоксальную способность GPT-4 и подобных моделей выполнять даже те задачи, которые не закладывались при глубоком обучении. Исследователи указывают на то, что большие языковые модели ведут себя так, как, согласно учебникам математики, они не должны. Так, изначально они не могут выполнить задачу, но в какой-то момент все же выдают результат без дообучения. Этот момент ученые назвали гроккингом и сравнивают его с озарением у человека. О гроккинге упоминает и Илья Суцкевер, который считает, что явление может служить признаком «разумности» ИИ. Кроме того, ИИ каким-то образом не просто запоминает закономерности, но и придумывает правила, которые позволяют применять эти закономерности в новых ситуациях. По мнению исследователей, если в ближайшие годы удастся понять такое поведение моделей, то это понимание может серьезно повлиять на фундаментальные науки, в том числе на статистический анализ. В свою очередь, появление новых фундаментальных теорий сделает разработку ИИ более предсказуемой, а значит — безопасной.