Об авторе: Алексей Замесов, партнер компании Exectica Capital.

Недавнее исследование Apple, озаглавленное

«Иллюзия мышления: понимание сильных и слабых сторон языковых моделей» (The Illusion of Thinking: Understanding the Strengths and Limitations of Reasoning Models), проливает свет на фундаментальный вопрос: что представляет собой понятие «мышление» в контексте современного искусственного интеллекта? Авторы смело называют этот процесс иллюзией и наглядно показывают, чем он отличается от человеческого разума.

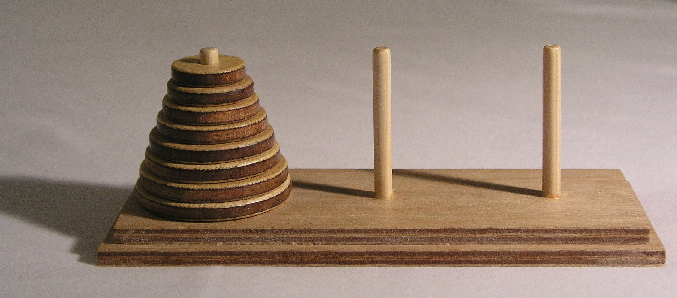

Проблема масштабирования: почему 8 дисков сложнее 5

Ключевое различие кроется в способности к абстракции и масштабированию. Человек, решив задачу, усваивает ее базовый принцип. Например, поняв логику решения головоломки «Ханойская башня» для пяти дисков, он без труда применит тот же принцип для любого другого их количества.

Исследование Apple показало, что для LLM ситуация кардинально иная. Модель может блестяще решить задачу для пяти дисков, но оказывается совершенно беспомощной, когда количество дисков увеличивается, например, до восьми, хотя для решения достаточно применить тот же самый принцип, которым LLM только что «воспользовалась».

Это не проблема памяти или объема контекста. Модели демонстрировали резкий спад производительности в переломной точке сложности, даже имея огромный запас вычислительных ресурсов. Что примечательно, это поведение было характерно для всех языковых моделей, независимо от их размера и мощности — от более простых до самых продвинутых. LLM не ищет логику задачи; она оперирует набором заученных паттернов, и как только задача выходит за рамки знакомых примеров, система дает сбой.

Зубрила, а не мыслитель: аналогия от Ричарда Фейнмана

Этот феномен прекрасно иллюстрирует история нобелевского лауреата Ричарда Фейнмана о его опыте преподавания физики в Бразилии. В своей книге «Вы, конечно, шутите, мистер Фейнман!» он рассказывает:

«Я обнаружил очень странное явление: я задавал вопрос, и студенты отвечали, не задумываясь. Но когда я задавал вопрос еще раз — на ту же тему и, как мне казалось, тот же самый вопрос, они вообще не могли ответить! .. После длительного расследования я, наконец, понял, что студенты все запоминали, но ничего не понимали».

LLM в задачах на логику — это и есть те самые «бразильские студенты» в своей электронной форме. Они могут выдать безупречно заученный ответ, если формулировка задачи совпадает с тем, что они «видели» в обучающих данных. Но малейшее изменение условий, требующее не воспроизведения, а именно применения знания, ставит их в тупик. Это мастерская компиляция и пересказ, но не подлинное понимание.

Почему это ставит под сомнение путь к AGI

В выводах авторы выражают обоснованный скепсис относительно возможности создания Общего искусственного интеллекта (Artificial general intelligence, AGI) на базе текущей архитектуры LLM. Настоящий интеллект подразумевает способность к абстрактному мышлению, формированию внутренних моделей мира и переносу знаний между разными доменами. LLM же, по сути, являются невероятно сложными системами по распознаванию и воспроизведению статистических закономерностей в тексте. Им не хватает того, что мы называем здравым смыслом или каузальным мышлением (пониманием причинно-следственных связей).

От иллюзии AGI к реальной пользе: сила узких сервисов

Тот факт, что AGI на базе LLM может и не появиться, не отменяет их потенциала. В ближайшие годы мы станем свидетелями взрывного роста мощных узкоспециализированных ИИ-сервисов, которым для эффективной работы достаточно «иллюзии мышления», это:

- автокодеры и ассистенты для разработчиков, которые пишут шаблонный код;

- ассистенты врачей, анализирующие истории болезней и предлагающие диагнозы;

- юридические помощники, которые быстро находят прецеденты и готовят черновики документов;

- системы управления данными;

- ускорители научных исследований (R&D).

Каждая из этих областей получит колоссальный экономический эффект, который с лихвой оправдает все инвестиции, даже если рынок пересмотрит свои слишком оптимистичные ставки на AGI.

LLM как идеальный переносчик знаний

Отвлекаясь от критики, важно признать главную суперсилу LLM — они являются идеальным интерфейсом к знаниям. Когда-то интернет совершил революцию, сделав информацию доступной по клику мыши. LLM делают следующий шаг — они радикально сокращают когнитивную дистанцию от человека до нужных ему знаний.

Раньше для изучения вопроса требовалось:

- Найти релевантные источники (поиск).

- Прочитать и отфильтровать их.

- Сопоставить факты и синтезировать собственное понимание.

Теперь достаточно сформулировать запрос к LLM, чтобы мгновенно получить структурированный всесторонний материал, максимально релевантный вашему вопросу, с возможностью тут же уточнить непонятные моменты. Большие языковые модели выступают в роли эксперта, который уже проделал всю черновую работу по подбору информации. Дистанция между «вопросом» и «знанием» стала как никогда короткой.

Выводы: что нас ждет?

- Не стоит ждать появления «настоящего» AGI в ближайшее время. Текущий подход, вероятно, является технологическим тупиком на пути к нему, и потребуются новые фундаментальные прорывы.

- То, что мы имеем сейчас — это огромный ресурсный задел. Потребуются годы, чтобы полностью адаптировать и интегрировать возможности LLM в нашу повседневную жизнь и рабочие процессы.

- Главный прорыв (disrupt) произойдет не в технологиях, а в процессах. Построение новых организационных систем и бизнес-моделей, основанных на мгновенном доступе к синтезированным «знаниям», перекроит корпоративный ландшафт в ближайшее десятилетие во многих отраслях. Победят не те, кто создаст лучший ИИ, а те, кто научится эффективнее всех его применять.

➤ Подписывайтесь на телеграм-канал «РБК Трендов» — будьте в курсе последних тенденций в науке, бизнесе, обществе и технологиях.