Нейробиологи из Техасского университета расшифровали данные сканирования мозга, применив систему искусственного интеллекта. Эту информацию использовали для того, чтобы восстановить мысли испытуемых при ознакомлении с мультимедийным контентом. Технология, в первую очередь, может быть полезной для людей, которые лишены речи или не могут общаться в силу перенесенных заболеваний и травм. РБК Тренды разбирались, как она работает и какие у нее перспективы.

Декодер для чтения мыслей

Исследователи разработали семантический декодер, который переводит мозговую активность в текст. Это неинвазивная система искусственного интеллекта, которая обучалась, пока человек часами слушал подкасты, находясь в сканере функциональной магнитно-резонансной томографии (фМРТ). В результате она генерирует текст из его мыслей только на основе активности мозга.

Декодер не расшифровывает мысли дословно, а пересказывает их. Например, когда участница эксперимента думала: «У меня еще нет водительских прав», то система выдавала такую мысль: «Она еще даже не начала учиться водить».

Как работает декодер

Джерр Танг, аспирант кафедры компьютерных наук, и Алекс Хут, доцент кафедры нейробиологии и компьютерных наук Техасского университета использовали записи фМРТ мозга трех участников. Такую томографию обычно проводят, чтобы отследить изменения в токе крови, вызванные нейронной активностью головного или спинного мозга. фМРТ позволяет определить, как и каким образом разные области головного мозга работают под влиянием различных физических факторов.

Исследователи применили модели декодирования языка, известные как декодеры речи. До сих пор они использовались для расшифровки данных с устройств, имплантированных в мозг человека. Другие же декодеры, которые используются при расшифровке мозговой активности без хирургического вмешательства, могли распознавать только отдельные слова или короткие фразы.

Авторы разработки при помощи фМРТ выяснили, какие паттерны формируются в областях мозга, отвечающих за обработку языка. Сначала они записали, какие семантические представления возникают в мозге при просмотре и прослушивании разного контента. Семантические представления — это результат активности мозга, который можно записать в виде последовательности слов, восстанавливающей значение воспринимаемого контента. Затем эти записи использовали для обучения декодера. Выяснилось, что он может восстанавливать связную речь, если использует такие записи, полученные из нескольких областей мозга.

Система анализировала реакции мозга трех участников, когда они слушали разные истории. Затем обученный на записях мозга декодер сгенерировал те последовательности слов, которые могли вызывать определенную мозговую активность при прослушивании разных сюжетов в ходе эксперимента. Эти предположения декодера отражали общий смысл содержания подкастов, а в некоторых случаях даже включали точные слова и фразы из них.

Затем исследователи попросили участников смотреть немые фильмы, и декодер смог передать суть этих историй и мысли испытуемых в момент просмотра.

Когда же участникам включали одновременно несколько историй, то система могла пересказать ту из них, которую они слушали активно, а не в фоновом режиме.

Как обучали алгоритм

Исследователи начали с того, что поместили каждого участника испытания внутрь сканера фМРТ на 16 часов, где он прослушал четыре разных подкаста. При этом сканер считывал реакции мозга человека.

Затем эту информацию использовали для обучения кодировщика. Это вычислительная модель, которая предсказывает, как мозг будет реагировать на заданную последовательность слов. Модель кодировщика связывает определенные реакции мозга с теми семантическими представлениями, которые их вызывают. Для этого в системе используется языковая модель GPT, предшественник GPT-4.

Декодер генерирует последовательности из слов, которыми могли быть вызваны наблюдаемые реакции мозга. При этом он выдает несколько предположений, которые ранжируются в порядке точности. Модель отбрасывает самые неудачные и сохраняет удачные, а затем угадывает точную последовательность слов в них. После этого точность каждой «догадки» проверяется путем сравнения прогноза с фактически зарегистрированной активностью мозга.

В чем особенность алгоритма

Большинство систем декодирования связывают данные мозга с двигательными особенностями или активностью, зарегистрированной в тех областях мозга, которые участвуют в последнем этапе вывода речи — движениях рта и языка. Разработанный декодер же работает с другими зонами мозга — теми, где генерируются идеи и смыслы. Так, исследование показало, что для наиболее точных прогнозов декодера требуются данные из речевой сети мозга, теменно-височно-затылочной ассоциативной области и префронтальной коры.

Чтение мыслей через портативные системы

Одним из ограничений использования данных фМРТ стало их низкое временное разрешение. Сигнал, зависящий от уровня кислорода в крови, нарастает и падает примерно в течение 10 секунд — за это время человек может услышать 20 или более слов. В результате метод не позволяет обнаруживать отдельные слова, а только считывает потенциальные значения их последовательностей.

Также исследователи выяснили, что декодер, обученный на мыслях одного человека, плохо работал при предсказании активности мозга другого. Если же испытуемый отвлекался во время эксперимента или намеренно переключал свое внимание, чтобы обмануть декодер, то и система тоже сбивалась с повествования. На качество ее работы влияли и движения людей внутри сканера фМРТ, к которым он крайне чувствителен.

Наконец, в настоящее время декодер работает только с данными фМРТ, а это дорогостоящая процедура.

Однако авторы исследования считают, что разработку в перспективе можно будет использовать в более портативных системах визуализации работы мозга, таких как функциональная спектроскопия в ближнем инфракрасном диапазоне (fNIRS). Это неинвазивный метод, позволяющий регистрировать активность коры головного мозга.

fNIRS гораздо менее восприимчива к электромагнитным помехам со стороны окружающей среды и поддерживает интеграцию с другим оборудованием, таким как очки виртуальной реальности, айтрекеры (приборы для отслеживания взгляда) или аппараты электроэнцефалографии (ЭЭГ).

Альтернативные разработки для чтения мыслей

Ученые Университета Радбауд в Нидерландах в 2022 году представили генеративную модель ИИ, которую обучили на данных фМРТ, чтобы она преобразовывала визуальные образы, возникающие в мозге, в реальные изображения.

Исследователи по несколько раз показывали участникам во время фМРТ наборы картинок. 36 из них были специально сгенерированными лицами людей, на которых потом проверяли точность работы нейросети. Саму модель ИИ при этом предварительно обучили на 1050 картинках, куда входили и исходные 36. После этого нейросеть научили интерпретировать реакции мозга участников эксперимента на разные картинки. В итоге она могла правильно определять, какое конкретно лицо из набора данных видели испытуемые.

Однако нейросеть прошла специальное обучение на данных о реакции мозга конкретных людей. Если бы в эксперименте принял участие новый испытуемый, у которого реакции мозга были бы другими, модель ИИ уже не смогла бы дать точных результатов при их анализе.

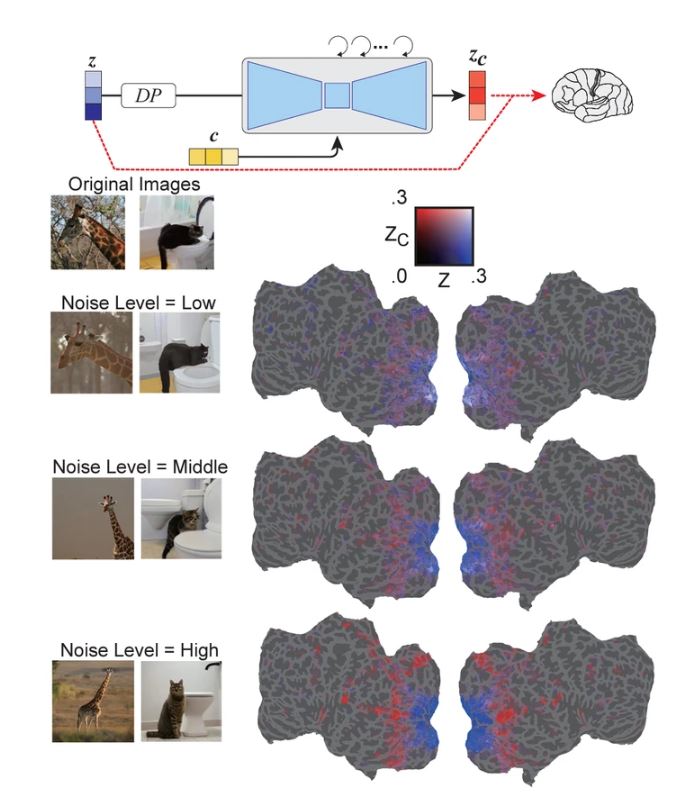

Позднее в 2022 году исследователи из Высшей школы передовых биологических наук Университета Осаки смогли реконструировать высокоточные изображения активности мозга с помощью модели генерации Stable Diffusion, которую уже не требовалось специально обучать для этого.

Это отличает новую работу от предыдущей, в которой модели требовалась тонкая настройка, и снимает ограничения на применение генеративного ИИ, поскольку обучающие модели в нейробиологии достаточно сложны, а у исследователей не так много образцов для работы.

Сначала ученые предсказали реакции мозга путем расшифровки сигналов мозга, полученных через фМРТ. Затем они создали модель этих предсказаний. Для того, чтобы она научилась интерпретировать сигналы мозга более точно, в нее добавили так называемые «шумы». Они используются в моделях генерации картинок для повышения точности предсказаний. Шумы — это слои, которые накладываются поверх картинки, а нейросеть учат поэтапно удалять их, чтобы максимально точно угадать исходное изображение. При этом используется система поощрений, когда ИИ делает верный шаг. Так, Stable Diffusion использует процесс скрытой диффузии при удалении шума: вместо прямого создания скрытой картинки она генерирует текстовую подсказку, чтобы постепенно воссоздавать ее.

Новое исследование еще и показало интересные зависимости. Например, чем выше был уровень реакции мозга на раздражитель в виде картинки, тем выше получалось разрешение итогового изображения.

Пока ученые выясняют, как генеративный ИИ можно использовать для чтения мыслей, представители сферы искусства уже давно применяют преобразователи электрических импульсов мозга в своих экспериментах. В 2014 году художник из Шанхая Джоди Сюн с помощью биосенсоров ЭЭГ подключил шестнадцать человек с ограниченными возможностями к воздушным шарам с краской. После этого участники «силой мысли» взрывали конкретные шары, чтобы создавать собственные картины.

Педагоги летнего творческого лагеря Capital One в Техасе в 2018 году создали установку, позволяющую преобразовывать электрические импульсы в мозге в звуки и свет. Студенты лагеря использовали ЭЭГ-гарнитуры, которые передавали сигналы на компьютер, где волны мозга отображались в виде цвето-музыки.