Как мы переживаем эмоции?

Об эксперте: Марина Чурикова, Lead Research Scientist в Neurodata Lab.

Эмоции — это комплексный психофизиологический ответ организма на события, происходящие в нашей жизни. Чтобы понять, можно ли научить нейросети эмоциям, вначале нужно разобраться с тем, что мы сами понимаем под эмоциями и как мы их переживаем.

Обычно переживание какой-либо эмоции включает в себя:

- некоторое внутреннее состояние, которое в обиходе и называется «эмоцией» (когда человеку грустно, страшно, или он испытывает радость);

- сопутствующие ему физиологические реакции (комплекс процессов, которые происходят в нервной, дыхательной, сердечно-сосудистой, и эндокринной системах организма);

- внешние проявления (изменения мимики, движений, жестов, интонации)

Можно ли научить ИИ испытывать что-то похожее?

Сможет ли нечто, не обладающее биологическим телом, когда-нибудь что-нибудь «испытывать» — сложный вопрос, на который мы пока не знаем ответа (хотя такой вариант довольно занимательно описан в рассказе Терри Биссона «Они сделаны из мяса» и фильме «Из машины»).

На данный момент мы можем научить ИИ лишь распознавать человеческие эмоции опосредованно через внешние проявления и реакции человеческого тела и демонстрировать (но не ощущать) сопереживание и эмпатию. Для того чтобы этого достичь, нужно последовательно пройти три этапа:

- нужно научить нейросеть распознавать эмоции собеседника-человека, чтобы сориентироваться в ситуации;

- затем научить ее синтезировать соответствующий ситуации ответ;

- научить ее выдавать этот ответ в форме правильной эмоциональной реакции.

Ладно, как это сделать?

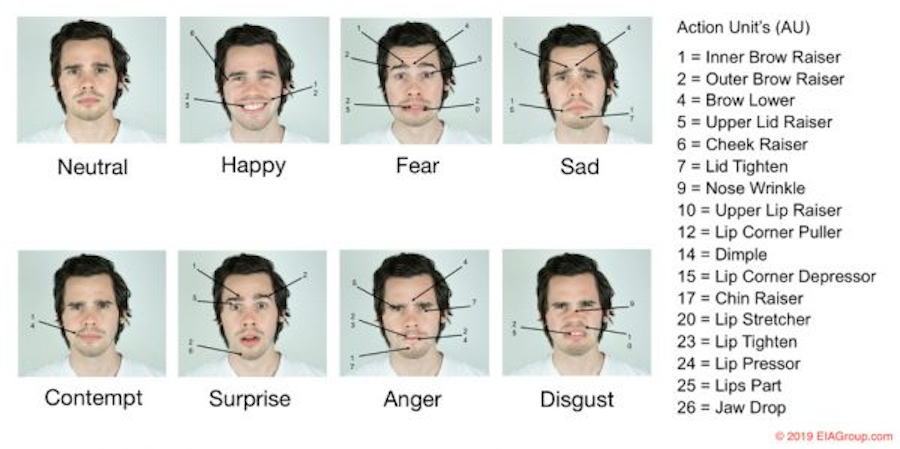

Первый этап — распознавание эмоций человека — ИИ уже неплохо освоил. Самые простые методы распознавания эмоций основаны на анализе взаимного расположения разных мимических сегментов лица. Сюда относится, например «система кодирования лицевых движений» (FACS) Пола Экмана, которая была положена в основу сериала «Обмани меня». Такая система может работать и без участия нейросетей: по сути, она выделяет ключевые точки на лице, затем по этим точкам распознает определенные области лица и их смещения.

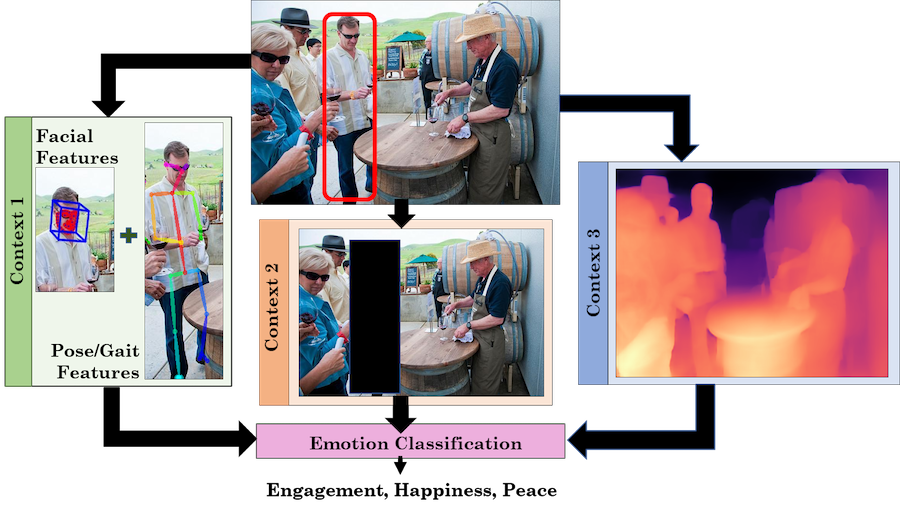

В современной науке подход Экмана признан устаревшим и подвергается критике, одна из причин которой — то, что его методика опирается на движения лицевых сегментов, которые далеко не всегда соответствуют определенной эмоции. Поскольку переживание эмоций может сопровождаться изменениями не только в мимике, но также в физиологии и поведении, то сейчас наиболее точным считается мультимодальное распознавание эмоций. Этот метод предлагает анализировать не расположение отдельных областей лица (например, поднялись брови вверх или сошлись у переносицы), а все лицо целиком на протяжении какого-то времени, ведь переживание любой эмоции имеет свою длительность и фазы. Кроме того, мультимодальный подход также включает анализ жестов, речи и интонации человека и его физиологических параметров.

Собрать все составляющие такой системы довольно сложно, но ученые достигли очень высокого уровня точности: например, сейчас мы располагаем алгоритмами, которые определяют частоту пульса и дыхания человека по видео, а ведь еще недавно это казалось фантастикой. Также на текущий момент мы уже можем неплохо распознавать интонацию, тембр и эмоциональную окрашенность голоса по аудиопотоку, что может использоваться, например, в разработке голосового помощника, где видеопоток недоступен.

Второй этап — синтез эмоционального ответа, то есть расчет того, какую реакцию ИИ должен выдать в ответ на какие-то человеческие эмоции. Синтез зависит не только от того, какую эмоцию ИИ распознал на первом этапе, но и от контекста происходящего — то есть, от ситуации, в которой находится человек, который взаимодействует с ИИ. Контекст играет важную роль в человеческом общении: мы воспринимаем всю ситуацию целиком, и сами интерпретируем эмоции собеседника не только в зависимости от выражения его лица, но и исходя из нашего жизненного опыта и того, как мы понимаем его состояние и слова. Например, если вы стоите в пробке, у вас текут слезы и вы задыхаетесь, то ИИ-помощник может интерпретировать выражение вашего лица и частоту дыхания как «грусть» и подготовить ответ, который должен вас утешить. На самом же деле у вас аллергия на пыльцу, вы забыли таблетки дома и ситуация приводит вас в ярость. Вам нужно не утешение, а адрес ближайшей аптеки, причем озвученный тоном, который не разозлит вас еще больше.

У нейросети «понимание» контекста может осуществляться через анализ окружающих предметов, собеседника, места и прочих доступных видимых параметров, но человеческим жизненным опытом ИИ не обладает. Для ИИ «опыт» — это все те данные, на которых он обучался, он ограничен ими и не может выйти за их пределы.

При синтезе эмоционального ответа нейросеть сможет выбрать его только из тех вариантов, которые ей показали при обучении. Люди же обладают уникальным жизненным опытом, который накапливают всю жизнь, отчего наши эмоции отличаются гибкостью и адаптацией к меняющемуся миру вокруг нас. Кроме того, огромная часть нашей коммуникации обусловлена обществом и культурой: мы проводим много времени на работе, в транспорте и общественных местах, где внешнее выражение эмоций ограничено определенными правилами поведения. Вдобавок наши эмоции могут быть спонтанными и во многом зависят от индивидуальных личностных черт, темперамента, особенностей нервной системы. Даже если представить, что ИИ сможет постоянно дообучаться, будет очень сложно записать и оцифровать все это многообразие реакций и контекстов. В данный момент сложно представить себе нейросетевой алгоритм, способный на такую гибкость.

Кроме того, есть и культурные особенности — например, у ряда культур существуют специальные понятия и знаковые системы для описания эмоций и состояний, которые отсутствуют в английском или русском языке. Это тоже добавляет сложности обучению эмпатичной нейросети.

И, наконец, третий этап — генерация ответа эмоциональным ИИ. Она должна быть достаточно точной и плавной, чтобы человек воспринимал это как естественный процесс и не ощущал, что общается с автоответчиком. Тогда алгоритму нужно воссоздать внешнее выражение эмоций — как минимум, сгенерировать эмоциональное лицо на изображении или видео с сопутствующими жестами и естественной интонацией ответа. Если же ИИ воплощен в механическом роботе, то, возможно, придется дополнительно поработать над пластичностью мимики его лица, плавными и естественными движениями конечностей и туловища (но не настолько, чтобы сделать его полностью антропоморфным, ведь такие объекты вызывают у нас дискомфорт). Вдобавок, вся эта реакция — лицо, мимика, движения и речь — должна генерироваться так же быстро, как это происходит в обычной беседе между людьми.

И все-таки, хотя бы в теории такое возможно?

Некоторые футурологи, например Рэй Курцвейл, считают, что искусственный интеллект будет развиваться по экспоненте, поскольку он создается на основе уже существующих технологий. И что, скорее всего, мы еще при жизни сможем застать появление по-настоящему сильного общего ИИ, способного, в том числе, осознавать себя и возможно даже испытывать эмоции. Однако его появление может создать неожиданную проблему: ИИ может не только достичь человеческого уровня интеллекта, но и сильно превзойти его за очень короткий срок. В результате мы как вид можем оказаться в положении, когда нам придется сосуществовать с чем-то, чьи расчеты, намерения, эмоции и мотивы будут слишком сложны для нашего понимания.

Произойдет ли все так, как предсказывает Курцвейл? Сможет ли ИИ в самом деле переживать эмоции? И будут ли они так уж отличаться от наших? Посмотрим.